科研背景

近年来,随着隐私保护及数据安全法律法规的逐渐完善,数据孤岛问题变的日益严峻。数据孤岛,因为现在各行各业的数据都被不同的机构企业所拥有。比如政府银行医院他们所拥有的数据的维度类型差异很大,但实际上这些数据不能够给到彼此,无论站在合规的角度还是资产保护的角度,特别是越有价值的数据。越有价值的数据往往越不能够流动出去。数据不能溜出去,数据的价值可以溜出去, 只有数据的价值溜出去了才能变现,掌握有价值的数据才能变成价值,这中间存在一种矛盾。

隐私计算是“数据可用但不可见”技术的集合,包括FL,安全多方计算(MPC),可信执行环境(TEE),差分隐私(DP)等。其中,FL是一种将分发机器学习与隐私技术相结合的衍生技术他们往往比较高效,但是做不到可证安全,大家觉得它可以保护隐私,但是保护的程度是多少,不能去保证。Zhu L , Liu Z 等人工作指出,联邦学习中恶意参与方或服务器可以通过客户端本地模型更新中推测出客户端本地数据的属性以及时候存在某条数据等隐私信息(属性推理攻击,成员推理攻击,模型反演攻击等等)。

研究现状

科研目的

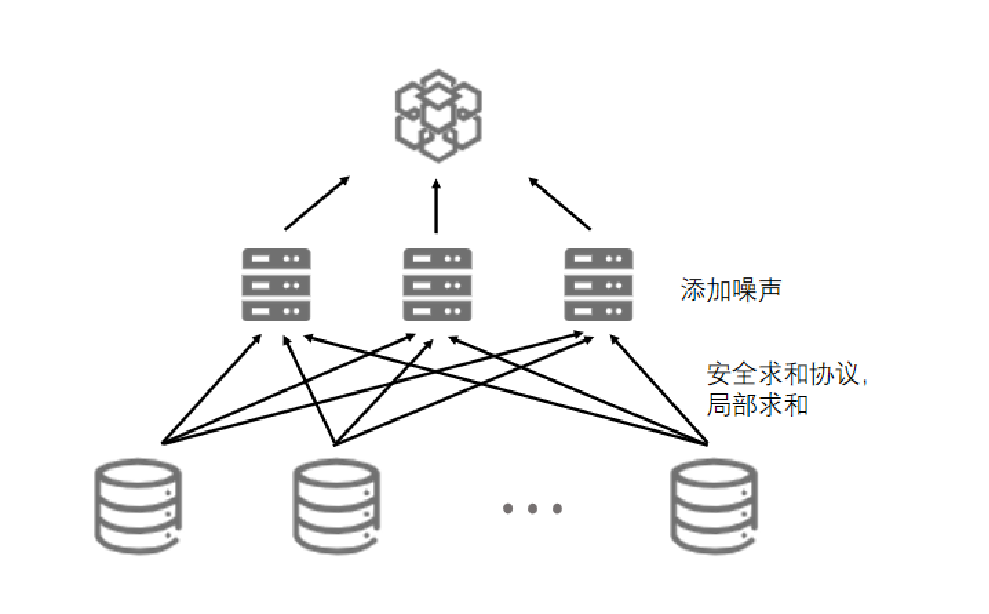

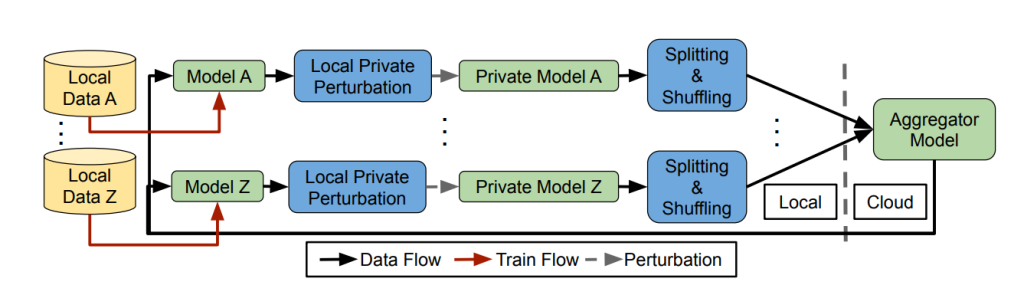

本文将差分隐私和多方安全计算相结合,提供了一种新的解决思路,用户不再对本地训练得到的本地模型添加扰动,首先将本地模型秘密共享至多个服务器,把LDP转变为多个CDP。保护隐私不被泄露的同时最大限度减少精度损失。

研究内容