科研背景

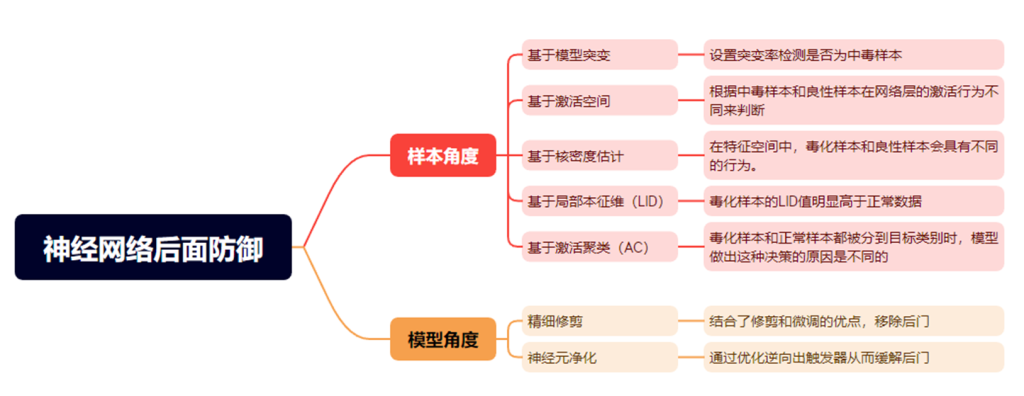

后门攻击是AI安全领域目前非常火热的研究方向,其涉及的攻击面很广,在外包阶段,攻击者可以控制模型训练过程植入后门,在协作学习阶段,攻击者可以控制部分参与方提交恶意数据实现攻击,甚至在模型训练完成后,对于训练好的模型也能植入后门模块,或者在将其部署于平台后也可以进行攻击。随着攻击的研究逐渐深入,相关的防御方案也被提了出来,对于攻击者而言,接下来再要设计攻击方案,必须要考虑是否能够规避已知的防御方案,而对于防御者而言,需要考虑已有防御方案的缺陷,以及如何改正,才能进一步提高检测效率,不论是从哪方面来看,都有必要对目前典型的防御方案做一个全面的了解。本报告就会从样本和模型两个角度,介绍目前典型的方案。

科研问题

1、深度神经网络(DNN)缺乏透明度,使它们容易受到后门攻击,其中隐藏的关联或触发器会覆盖正常的分类,从而产生意想不到的结果。

2、后门可以无限期地保持隐藏,直到被输入激活,并且对许多安全或安全相关的应用(例如,生物识别认证系统或自动驾驶汽车)造成影响。

科研目的

1、寻找一个强大的和可推广的DNN后门攻击的检测和缓解系统,此系统可以识别后门并通过输入过滤器、神经元修剪和遗忘识别等多种技术缓解后面攻击。

2、提出新的可推广的技术,用于检测嵌入在深度神经网络中的隐藏触发器,从而对神经网络后门攻击进行防御。

科研内容