研究背景及意义

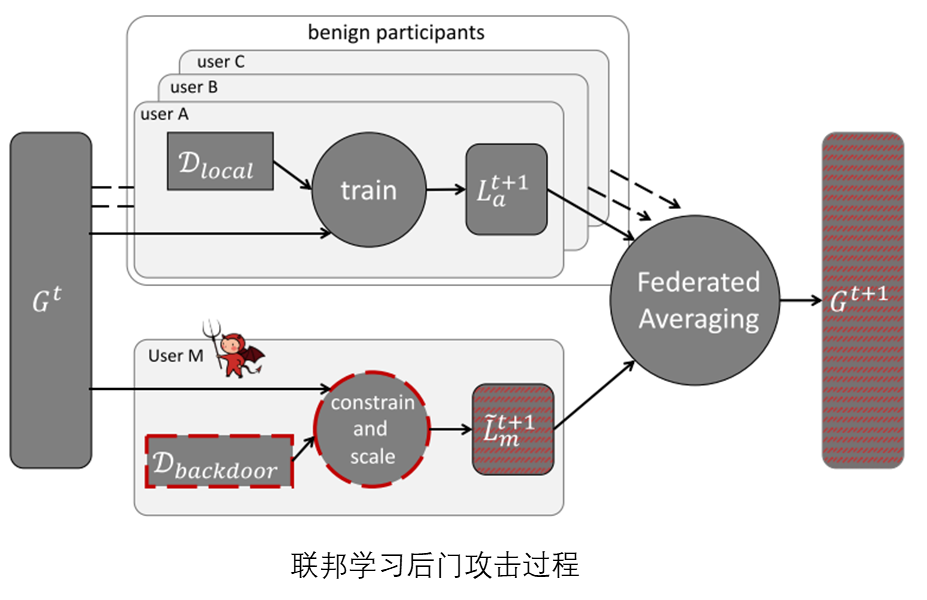

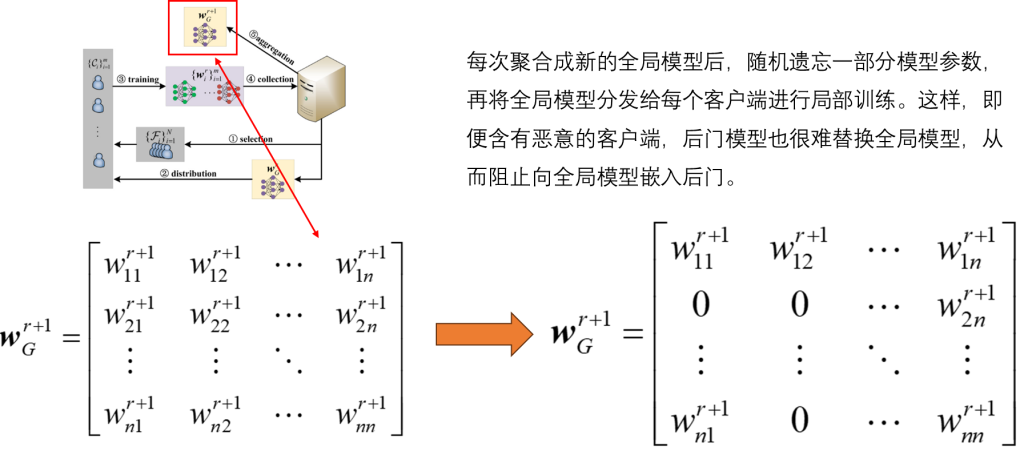

由于联邦学习的分布式架构,更容易受到对抗性攻击,包括非目标攻击和目标攻击。数据中毒攻击和模型中毒攻击是两种类型的非目标攻击,其目的是通过恶意修改本地数据集或本地模型参数来降低聚合模型的性能。一般来说,如果没有防御部署在联邦学习模型上,一个单一的对手可以成功地实施无针对性的攻击,这让防守变得更加困难。后门攻击是联邦学习中典型的有针对性的攻击,它比无针对性的攻击具有更强的隐蔽性和入侵性。具体地说,攻击者将后门模式嵌入到聚合模型中,并进一步使模型在主任务和后门任务上都表现良好。为了使联邦学习对后门攻击具有更强的鲁棒性,很多学者都对联邦学习后门防御进行了研究,例如:Zhu等人提出了一种基于对抗性蒸馏的新型后门防御方案 ADFL,ADFL 通过在服务器端部署生成式对抗网络(GAN)生成包含后门特征的虚假样本,并对虚假样本重新标记以获得蒸馏数据集;Lu等人设计了收敛轮攻击下基于模型预聚合和相似性度量的后门模型检测和清除防御方案;早期轮攻击下基于后门神经元激活的后门模型清除防御方案。鉴于现有的防御方案需要单独部署新的网络模型效率较低,本次汇报提出了一种更高效的联邦学习后门防御方案。

研究内容

总结