本次组会我将汇报对于近期在联邦学习后门防御的文献调研情况,对一些常用于对比的sota防御方法和最新的顶会论文等进行汇报。在本次组会汇报中我将从以下几个方面联邦学习后门防御方法进行介绍:科研背景、文献汇报、个人总结与思考,未来的研究计划、参考文献。

科研背景

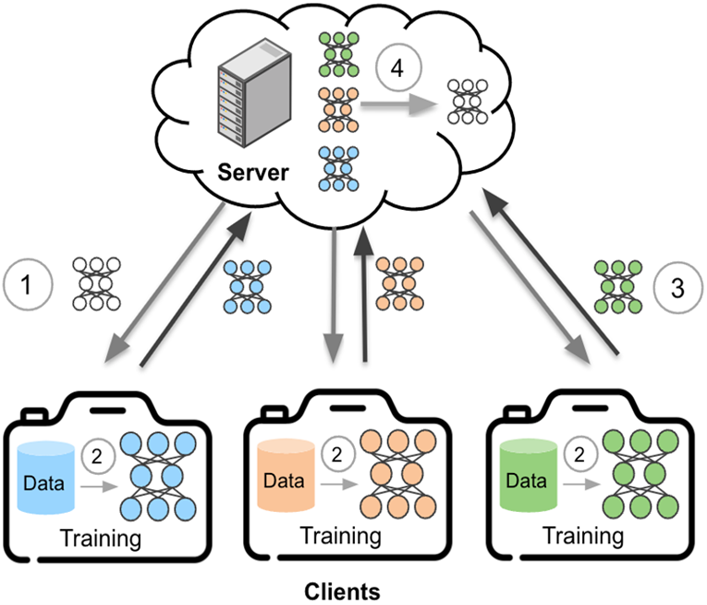

联邦学习是一种分布式机器学习训练过程,它的提出是解决集中式机器学习需要面对的数据孤岛和数据隐私问题。联邦学习中常用的架构是C-S架构,其中包含两类角色:多个客户端与一个中心聚合服务器。他们联合起来训练一个统一的全局模型。

(1)模型初始化与分发:中央服务器在第一轮确定学习任务,初始模型参数生成初始的全局模型,并将其分发给客户端。

(2)本地训练:各客户端利用本地的私有数据对模型进行训练,得到本地的局部模型。

(3)模型上传:本地向服务器上传本地训练后的模型参数

(4)模型更新:服务器根据指定的聚合方法将各个客户端上传的模型权重与全局模型进行更新后,将新的全局模型下发给客户端。

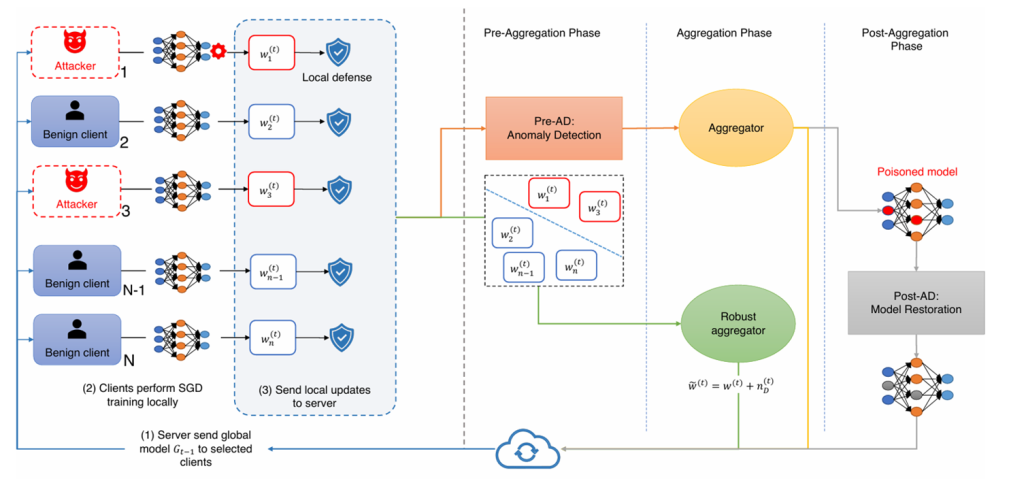

投毒攻击的主要目的在于通过恶意梯度或恶意数据降低全局模型的准确度。后门攻击也是通过数据投毒或模型投毒实现,在联邦学习中许多研究者将后门攻击归纳为特殊的投毒攻击。 后门攻击影响目标子任务的性能,全局模型在正常情况下表现良好,在某一类数据上准确度降低。联邦学习的后门攻击具有很强的隐蔽性,需要设计特定的防御方法来减轻后门攻击的影响。

文献列表

其余部分我会在组会详细介绍